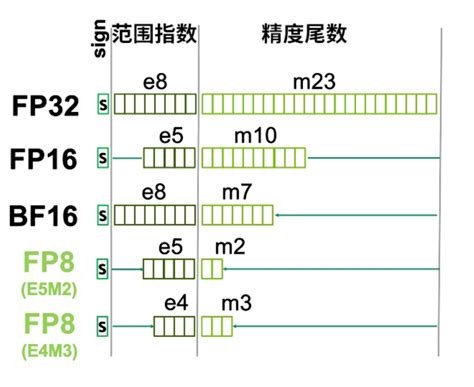

FP16(半精度浮点数)是一种16位浮点数格式,其设计旨在平衡精度与计算效率,广泛应用于深度学习、图形处理和高性能计算等领域。FP16的结构由1位符号位、5位指数位和10位尾数位组成,遵循IEEE 754标准。与FP32(单精度浮点数)相比,FP16的内存占用更少,计算速度更快,但精度较低。

FP16的主要优势在于其在内存和计算效率上的优化。由于其占用16位存储空间,相比FP32的32位,FP16的内存占用减半,从而减少了内存带宽和计算资源的消耗。在深度学习中,FP16常用于加速模型训练和推理过程,特别是在大规模并行任务中,如AI推理服务和图像处理。此外,FP16在GPU(如英伟达A100、H100)中通常具有更高的算力,支持FP16算力是FP32的2-4倍,显著提升了计算效率。

尽管FP16在精度上不如FP32,但其在许多应用场景中仍能满足需求,尤其是在混合精度训练中,通过结合FP16和FP32的使用,可以在保证模型精度的同时,提高训练和推理的效率。例如,在训练过程中,FP16可用于大部分计算,而关键操作(如梯度计算)则使用FP32以确保数值稳定性。

FP16的实现涉及多种技术,包括权重解耦、梯度放大和损失缩放等,以确保在FP16下进行运算时使用FP32进行计算,以避免精度丢失。此外,许多现代硬件(如NVIDIA GPU、ARM处理器)和软件框架(如CUDA、TensorFlow)都提供了对FP16的支持,以加速FP16的计算和转换。

FP16是一种重要的浮点数格式,通过平衡精度与效率,广泛应用于深度学习、图形处理和高性能计算等领域,是现代计算和AI技术的重要组成部分。

声明:文章均为AI生成,请谨慎辨别信息的真伪和可靠性!