权重正则化(Weight Regularization)是一种在机器学习和深度学习中广泛使用的技术,主要用于防止模型过拟合,提高模型的泛化能力。其核心思想是通过在损失函数中添加一个正则项(Regularization Term),对模型的权重(Weights)进行约束,从而限制模型的复杂度,避免模型对训练数据的过度拟合。

权重正则化的基本原理

权重正则化通过在损失函数中添加一个与权重相关的惩罚项,使得模型在训练过程中倾向于选择更简单、更平滑的解。这种正则化方法可以防止模型在训练数据上表现良好,但在未见过的数据上表现不佳(即过拟合)。

常见的正则化方法

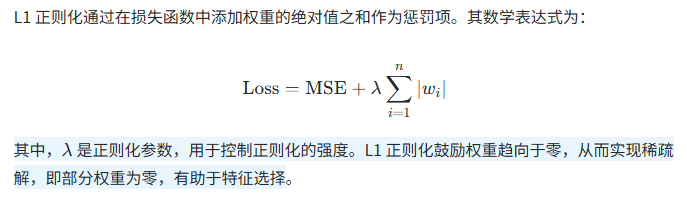

1. L1 正则化(L1 Regularization)

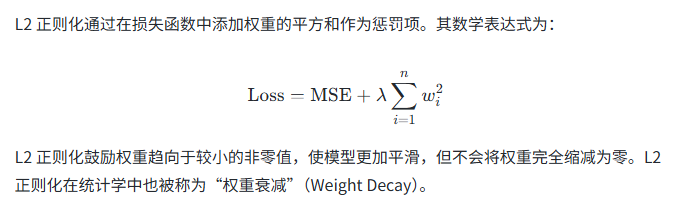

2. L2 正则化(L2 Regularization)

原始损失函数可以是交叉熵、均方误差等。

权重正则化的作用

- 防止过拟合:通过限制模型的复杂度,防止模型对训练数据的过度拟合,提高模型在未见过的数据上的泛化能力。

- 提高模型稳定性:通过约束权重的大小,使模型更加稳定,减少训练过程中的波动。

- 提升模型解释性:L1 正则化通过稀疏解,有助于特征选择,提高模型的解释性。

权重正则化在深度学习中的应用

在深度学习中,权重正则化是防止过拟合的重要技术之一。常见的应用包括:

- LSTM 模型:在时间序列预测中,通过权重正则化优化模型性能。

- 深度神经网络:在图像识别、自然语言处理等领域,权重正则化被广泛使用以提高模型的泛化能力。

- 优化算法:结合梯度下降等优化算法,权重正则化可以进一步提高模型的训练效率和性能。

权重正则化与偏置(Bias)的关系

在神经网络中,权重(Weights)和偏置(Bias)是模型的两个主要参数。权重正则化通常只对权重进行约束,而对偏置(Bias)的约束意义不大,因为偏置不会显著影响模型的复杂度。

总结

权重正则化是一种通过在损失函数中添加正则项来约束模型权重的技术,广泛应用于机器学习和深度学习中。通过 L1 和 L2 正则化等方法,可以有效防止模型过拟合,提高模型的泛化能力和稳定性。权重正则化是现代机器学习和深度学习中不可或缺的重要技术

声明:文章均为AI生成,请谨慎辨别信息的真伪和可靠性!